模仿鸟类非凡视力 仿生视觉技术突破

香港城市大学(CityUHK)的科学家开发了一款突破性的可穿戴仿生装置,模仿鸟类卓越视觉能力,并在近乎零耗电情况下运作。这项创新技术标志着朝更高效、先进的机器视觉系统的一大跃进,未来有望彻底改变自动系统与周围环境互动的方式。

机器视觉在快速识别与分类物件等许多时间敏感的场景中非常重要,对自动驾驶和机器人技术尤其关键。然而,传统的矽基视觉晶片面临巨大挑战,包括高能耗以及难以模仿复杂的生物行为。

城大协理副校长(企业)、材料科学与工程系何颂贤教授带领的研究团队克服这些限制,结合先进材料与神经网络架,研发出一套视觉系统,不仅能够在弱光环境下「看」得更清楚,而且能耗极低,并具备宽光谱非易失性存储功能。

何教授说:「将大面积的可穿戴视觉仿生装置整合到任何表面上,可以推进人工智能硬件走进日常生活,并与演算法深度融合。透过调整神经形态装置的阵列来适应深度神经网络,能够显著提升识别效率,同时降低能耗。」

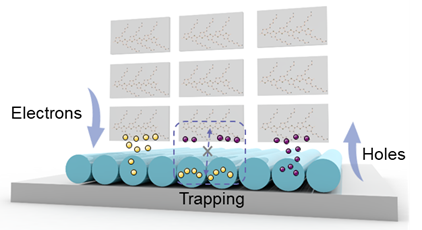

研究团队创新使用特殊定向的GaAs纳米线阵列,结合液态表面组装的 P3HT 有机薄膜形成范德瓦尔兹异质结。透过使用储备池计算系统,它能够成功识别移动物体的多种特征,包括形状、动态、颜色及UV灰阶资讯。

今次研究一大成就,是克服了精确控制半导体薄膜中分子取向的挑战。研究团队开发了可靠的方法,确保装置在不同表面上性能一致,使技术能高度适应各种不同的应用场景。

这项研究为智能视觉处理开辟了新可能。该装置具有整合至各类视觉感知系统的潜力,可望应用在智能驾驶、机器人技术及先进视觉装置。展望未来,研究团队将致力于将该系统与外部电路整合,以实现硬件与软件的无缝互动。

题为Birdlike Broadband Neuromorphic Visual Sensor Arrays for Fusion Imaging的论文近期已发表于期刊Nature Communications。

论文的第一作者是城大的谢朋杉博士、中南大学的徐运超博士及王静雯女士。通讯作者是城大的何颂贤教授及中南大学的孙佳教授。

如有查询,欢迎联络城大材料科学及工程学系的何颂贤教授(電郵:johnnyho@cityu.edu.hk)。